隨機森林與多輸出元估計器的比較?

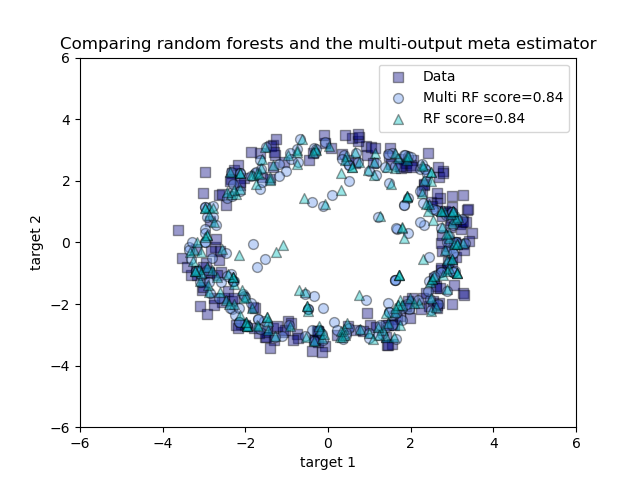

隨機森林的多輸出回歸器和multioutput.MultiOutputRegressor元估計器的比較。

這個例子說明了使用 multioutput.MultiOutputRegressor 元-估計器來執行多輸出回歸。一個隨機森林回歸器被使用來原生的支持多輸出回歸, 因此結果是可以比較的。

隨機森林回歸器只能預測每個目標在觀測范圍內或接近于零的值。因此,這些預測偏離圓周的中心。

使用單一的底層特性,模型學習x和y坐標作為輸出。

print(__doc__)

# Author: Tim Head <betatim@gmail.com>

#

# License: BSD 3 clause

import numpy as np

import matplotlib.pyplot as plt

from sklearn.ensemble import RandomForestRegressor

from sklearn.model_selection import train_test_split

from sklearn.multioutput import MultiOutputRegressor

# Create a random dataset

rng = np.random.RandomState(1)

X = np.sort(200 * rng.rand(600, 1) - 100, axis=0)

y = np.array([np.pi * np.sin(X).ravel(), np.pi * np.cos(X).ravel()]).T

y += (0.5 - rng.rand(*y.shape))

X_train, X_test, y_train, y_test = train_test_split(

X, y, train_size=400, test_size=200, random_state=4)

max_depth = 30

regr_multirf = MultiOutputRegressor(RandomForestRegressor(n_estimators=100,

max_depth=max_depth,

random_state=0))

regr_multirf.fit(X_train, y_train)

regr_rf = RandomForestRegressor(n_estimators=100, max_depth=max_depth,

random_state=2)

regr_rf.fit(X_train, y_train)

# Predict on new data

y_multirf = regr_multirf.predict(X_test)

y_rf = regr_rf.predict(X_test)

# Plot the results

plt.figure()

s = 50

a = 0.4

plt.scatter(y_test[:, 0], y_test[:, 1], edgecolor='k',

c="navy", s=s, marker="s", alpha=a, label="Data")

plt.scatter(y_multirf[:, 0], y_multirf[:, 1], edgecolor='k',

c="cornflowerblue", s=s, alpha=a,

label="Multi RF score=%.2f" % regr_multirf.score(X_test, y_test))

plt.scatter(y_rf[:, 0], y_rf[:, 1], edgecolor='k',

c="c", s=s, marker="^", alpha=a,

label="RF score=%.2f" % regr_rf.score(X_test, y_test))

plt.xlim([-6, 6])

plt.ylim([-6, 6])

plt.xlabel("target 1")

plt.ylabel("target 2")

plt.title("Comparing random forests and the multi-output meta estimator")

plt.legend()

plt.show()

腳本的總運行時間:(0分0.630秒)

Download Python source code:plot_random_forest_regression_multioutput.py

Download Jupyter notebook:plot_random_forest_regression_multioutput.ipynb