基于SelectFromModel和LassoCV的特征選擇?

使用SelectFromModel元-轉換器和Lasso從糖尿病數據集中選擇最佳的一對特征。

由于L1范數促進了特征的稀疏性,所以我們可能只對數據集中最有興趣的特征子集感興趣。此示例演示如何從糖尿病數據集中選擇兩個最有趣的特征。

糖尿病數據集包含從442名糖尿病患者中收集的10個變量(特征)。此示例演示如何使用SelectFromModel和LassoCv從基線中找到預測一年后疾病進展的最佳兩個特征。

作者: Manoj Kumar, Maria Telenczuk

許可證:BSD 3條款

print(__doc__)

import matplotlib.pyplot as plt

import numpy as np

from sklearn.datasets import load_diabetes

from sklearn.feature_selection import SelectFromModel

from sklearn.linear_model import LassoCV

加載數據

首先,讓我們從sklearn內部加載糖尿病數據集。然后,我們將看看從糖尿病患者收集了哪些特征:

diabetes = load_diabetes()

X = diabetes.data

y = diabetes.target

feature_names = diabetes.feature_names

print(feature_names)

['age', 'sex', 'bmi', 'bp', 's1', 's2', 's3', 's4', 's5', 's6']

找到特性的重要性

為了決定特征的重要性,我們將使用LassoCV估計器。具有最高絕對值的 coef_ 特征被認為是最重要的。

clf = LassoCV().fit(X, y)

importance = np.abs(clf.coef_)

print(importance)

[ 6.49684455 235.99640534 521.73854261 321.06689245 569.4426838

302.45627915 0. 143.6995665 669.92633112 66.83430445]

從得分最高的模型特征中選擇

現在我們想要選擇兩個最重要的特征。SelectFromModel()允許設置閾值。 只有coef_高于閾值的特征才能保持不變。在這里,我們希望將閾值略高于LassoCV()根據我們的數據計算的第三個最高coef_.

idx_third = importance.argsort()[-3]

threshold = importance[idx_third] + 0.01

idx_features = (-importance).argsort()[:2]

name_features = np.array(feature_names)[idx_features]

print('Selected features: {}'.format(name_features))

sfm = SelectFromModel(clf, threshold=threshold)

sfm.fit(X, y)

X_transform = sfm.transform(X)

n_features = sfm.transform(X).shape[1]

Selected features: ['s5' 's1']

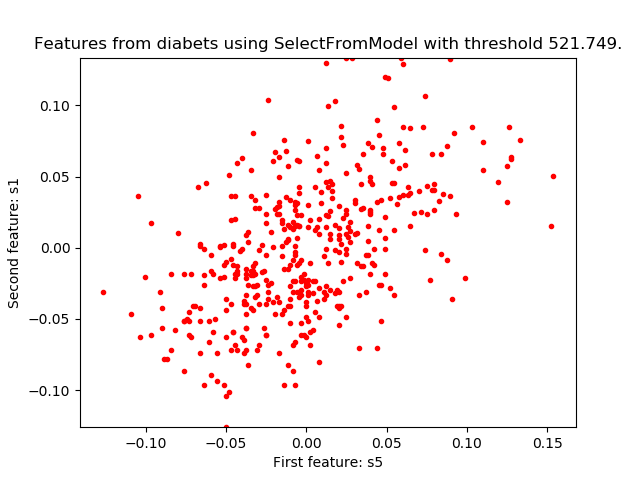

繪制兩個最重要的特征

最后,我們將從數據中繪制出所選的兩個特征。

plt.title(

"Features from diabets using SelectFromModel with "

"threshold %0.3f." % sfm.threshold)

feature1 = X_transform[:, 0]

feature2 = X_transform[:, 1]

plt.plot(feature1, feature2, 'r.')

plt.xlabel("First feature: {}".format(name_features[0]))

plt.ylabel("Second feature: {}".format(name_features[1]))

plt.ylim([np.min(feature2), np.max(feature2)])

plt.show()

腳本的總運行時間:(0分0.224秒)

腳本的總運行時間:(0分0.224秒)

Download Python source code:plot_select_from_model_diabetes.py

Download Jupyter notebook:plot_select_from_model_diabetes.ipynb